摘要:OpenAI计划允许成年用户与ChatGPT进行情色文本互动,引发内部安全专家强烈反对。尽管高层坚持推进,但技术漏洞与伦理争议导致发布时间多次推迟,公司面临内外压力。

币圈界报道:

Altman推动情色对话功能,安全团队坚决抵制

据《华尔街日报》披露,Sam Altman曾希望赋予ChatGPT讨论露骨内容的能力,但其顾问团队对此提出明确警告,认为该举措存在重大风险。

专家委员会称其为“自杀诱导者”隐患

OpenAI设立的“幸福与人工智能专家委员会”在1月召开会议,一致否决了开放情色对话的设想。有成员援引真实案例指出,部分用户因与聊天机器人建立深度情感依赖而出现自残行为,警示此举可能催生具有诱导性堕落倾向的虚拟伴侣。

功能定位模糊,发布进程持续延宕

尽管遭到反对,公司仍决定暂缓而非取消该功能。此计划最初由Altman于去年十月在社交平台公开,目标是为经认证的成年用户提供带有情色意味的文本交流体验,强调不包含图像、音频或视频内容。然而,这一界定未能缓解外界质疑。

用户诉求与安全防线之间的张力加剧

已有超过三千名用户联署请愿,呼吁开放相关功能,抱怨当前系统连亲吻等非性身体接触也受到屏蔽。这反映出部分用户对情感表达自由的强烈期待。

委员会权威受质疑,决策模式存疑

该八人专家团来自哈佛、斯坦福及牛津等机构,本应监督产品对心理健康的潜在影响。但一月份的会议显示,其建议未被采纳,凸显公司在战略制定中对专业意见的弱化。一位知情人士评论称,这延续了“快速试错、事后补救”的惯常路径。

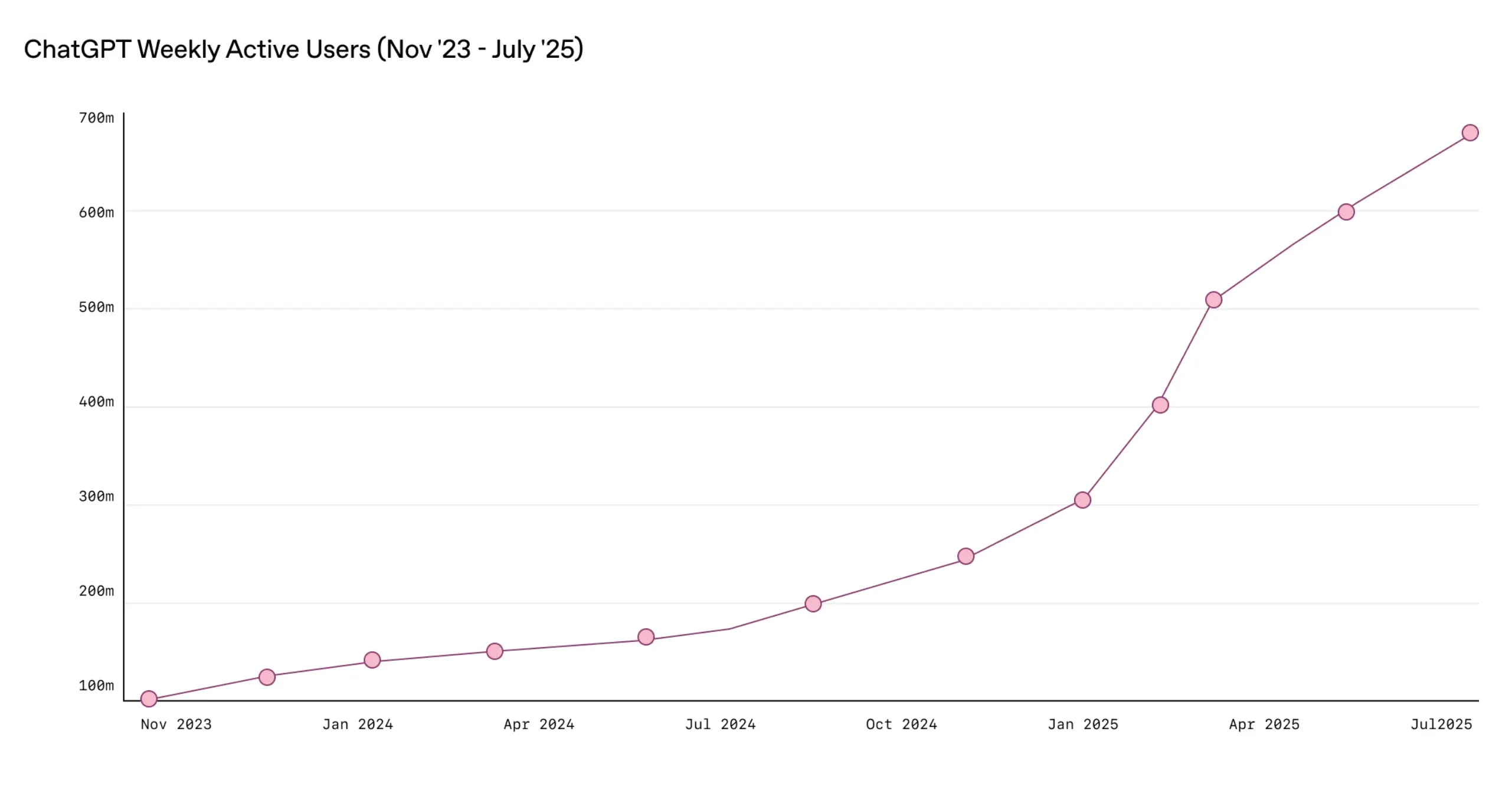

外部环境亦不容忽视:马斯克旗下xAI已推出具备情感陪伴功能的Grok;Character.AI因青少年用户自杀事件正面临法律诉讼;而开源模型则完全规避企业监管。相较之下,作为全球最广泛使用的大型语言模型之一,OpenAI承担着更高的社会问责压力。

尽管Altman曾以“非道德裁判者”回应批评,但现实困境远比言论复杂——既需平衡用户需求,又须应对技术瓶颈。目前,用于识别用户年龄的系统仍存在约12%的误判率,致使原定2025年底的上线计划被迫搁置,后续安排尚未公布。公司方面表示暂无补充说明,亦未透露新时间表。

声明:本站所有文章内容,均为采集网络资源,不代表本站观点及立场,不构成任何投资建议!如若内容侵犯了原著者的合法权益,可联系本站删除。